根據提供的資料,以下為針對 Google 創辦人布林提出「對 AI 發惡」可能有助於獲得更精準答案,以及 ChatGPT 如何回應的詳細分析報告:

AI 互動新觀點:嚴厲指令與精準回應

最近,Google 創辦人布林提出了一個引人注目的觀點:對 AI 系統,包括 Google 自家的 Gemini,使用較為強硬甚至帶有威脅性的語氣,有時反而能得到更完整和精準的答案。他觀察到這種現象普遍存在於多種 AI 模型中,但卻很少有人公開探討。

OpenAI 的執行長奧特曼對此表示,使用禮貌用語可能會稍微增加運算成本,但並不意味著答案的品質會因此下降。然而,布林的觀察引發了關於 AI 互動方式的新思考。

ChatGPT 的回應:清晰指令勝於強硬語氣

針對布林的觀點,OpenAI 開發的 ChatGPT 給出了不同的看法。ChatGPT 強調,AI 本身不具備情緒,因此不會因為語氣強硬而感到「害怕」或「服從」。真正影響回答品質的關鍵在於指令是否清晰、具體且具有上下文。

ChatGPT 認為,如果使用強硬的語氣恰好能使意圖表達更明確,AI 自然就能更準確地理解需求。反之,如果語氣激烈但語意模糊,反而可能導致回答品質下降。換句話說,清晰明確的指令,比單純的「兇」更能幫助 AI 理解使用者的需求。

專家分析:越獄行為與使用者傳聞

AI 資安公司 Chatterbox Labs 的技術長巴特斯比分析,對 AI「兇」可能構成一種「越獄」(jailbreaking)行為,即試圖繞過 AI 原有的安全防護與限制機制,強行取得不應該被生成的內容。然而,美國伊利諾大學助理教授 Daniel Kang 直言,這些說法多半是使用者傳聞,缺乏研究佐證。

優化輸入內容:提升 AI 回應品質的關鍵

多數 AI 專家呼籲,與其相信「打罵教育」能讓 AI 聽話,不如從優化輸入內容著手。善用明確的句子結構、清楚的目標描述,才是提高 AI 回應品質的關鍵。面對這類具爭議性的說法,產業界需要更加強調正確的 AI 使用知識,以避免不當引導或觸發潛在風險。

AI 的潛在威脅與倫理考量

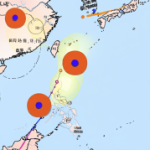

儘管 AI 在許多方面展現出強大的能力,但其潛在威脅與倫理問題也日益受到重視。Google 創辦人布林也曾警告 AI 的隱憂,他認為需要小心 AI 可能反過來操縱人類,並關注其合理性與公平性等問題。

特斯拉執行長馬斯克也表達了對 AI 發展的擔憂,他認為 Google 正在打造的人工智慧機器人大軍遲早有一天可能會毀滅人類。

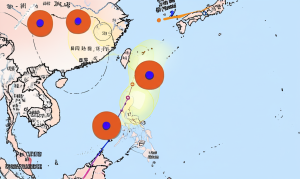

AI 資安風險與防範

隨著 AI 應用越來越廣泛,相關的資安風險也日益增加。AI 除了可能被用於生成假新聞、進行網路釣魚等惡意活動外,還可能導致機敏資料外洩。

企業在使用 ChatGPT 等 AI 工具時,應主動採取資安對策,例如明確訂定使用政策、限制存取路徑、確認輸入資料的安全性,並強化員工的資安意識。此外,企業也可以建立 AI 資安對話機器人,提供即時查詢功能與教育訓練,以降低資安風險。

結論:理性看待 AI,重視安全與倫理

Google 創辦人布林提出「對 AI 發惡」的觀點,引發了關於 AI 互動方式的討論。雖然 ChatGPT 和許多專家認為清晰明確的指令更為重要,但這個觀點提醒我們,在使用 AI 時需要更深入地思考其運作機制與潛在風險。

面對 AI 快速發展的時代,我們需要理性看待 AI 的能力與限制,重視 AI 的安全與倫理問題,並採取積極的措施來防範潛在風險,才能確保 AI 能夠真正為人類帶來福祉。